Dylemat wagonika frapuje filozofów i psychologów już od ponad 50 lat. Ostatnio znów jest o nim głośno za sprawą sztucznej inteligencji, a szczególnie autonomicznych samochodów, które będą musiały podejmować decyzje moralne za ludzi. Okazuje się, że odpowiedź na pytanie „Które wybrać zło, większe czy mniejsze?” oraz co jest jakim złem, zależy od tego, gdzie się urodziliśmy, wychowaliśmy i gdzie mieszkamy. Przynajmniej takie wnioski płyną z gigantycznego badania przeprowadzonego na MIT.

Eksperyment myślowy nazywany dylematem wagonika albo zwrotnicy w najbardziej rozpowszechnionej formie jaką znamy, wprowadziła w 1967 roku do obiegu Philippa Foot. Ale sam opis podobnego problemu pojawiał się już wcześniej. Po raz pierwszy można o nim było przeczytać już w 1905 roku w kwestionariuszu „moralnym”, jaki musieli wypełnić studenci University of Wisconsin.

Klasyczna wersja opowiada o następującej sytuacji: Maszynista nie może zatrzymać wagonu metra poruszającego się w tunelu. Widzi przed sobą pięciu robotników, którzy nie mają gdzie uciec, bo tunel jest za wąski. Jedyne, co może zrobić maszynista to zmienić tor. Problem w tym, że na drugim torze również znajduje się robotnik. Jak ma zachować się maszynista, który nie jest winny awarii? Czy nie robić nic i zabić 5 osób, czy zmienić tor i zabić jedną?

Rozważania na temat absolutyzmu moralnego i konsekwencjonalizmu zostawmy jednak filozofom i skupmy się na wynikach badań.

Moral Machine

Naukowcy z MIT Media Lab w związku z coraz szybszym rozwojem autonomiczności maszyn i związanymi z tym obawami co do tego, w jaki sposób będą one mogły w przyszłości podejmować moralne decyzje, wpadli na pomysł przeprowadzenia pewnego eksperymentu.

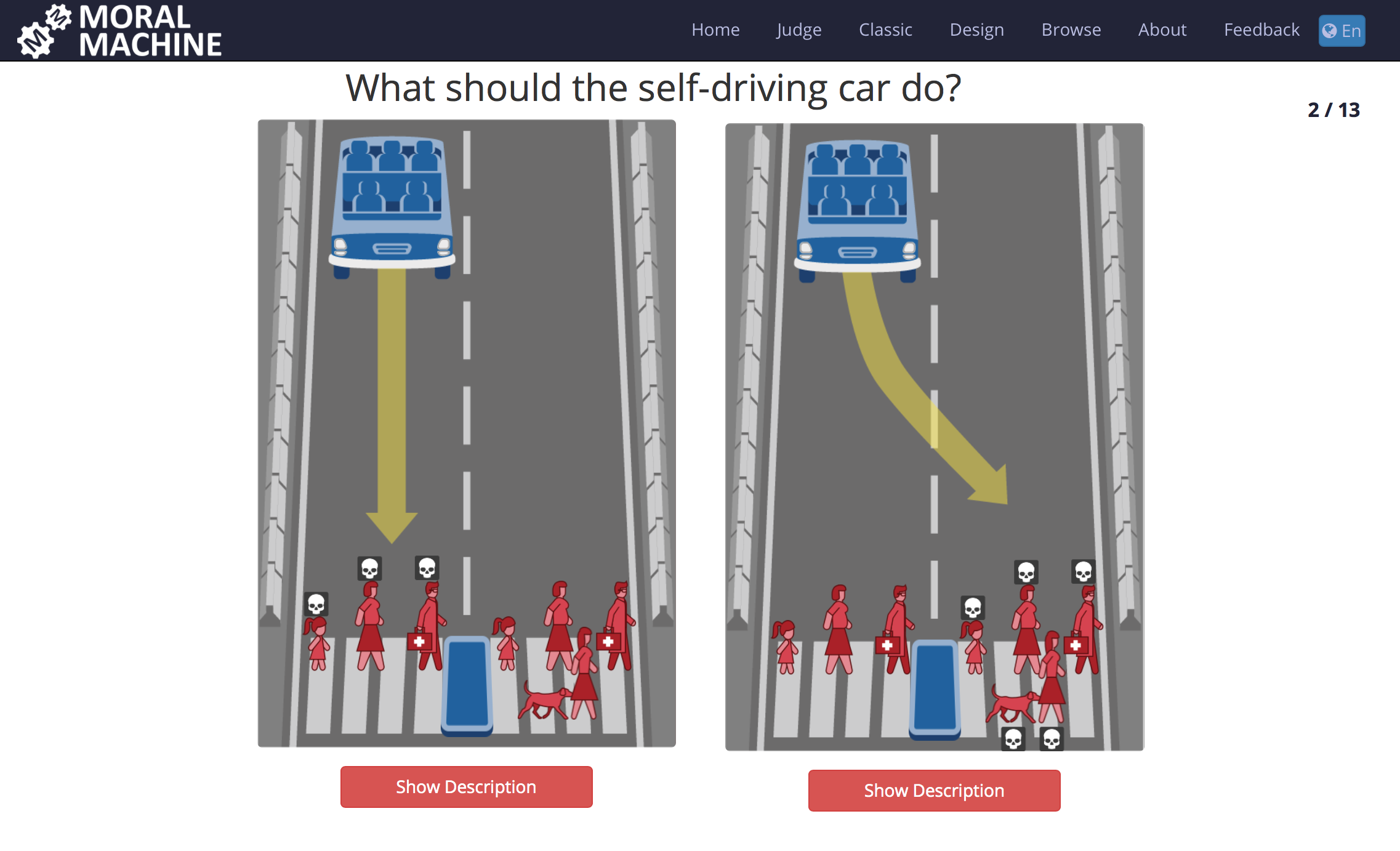

W 2014 roku uruchomili platformę Moral Machine, na której każdy, kto tylko zechciał mógł (i wciąż może) zdecydować co powinien zrobić autonomiczny samochód, stojący przez dylematem wagonika. Badacze MIT-u jednak nie ograniczyli się tylko do tego jednego scenariusza, ale oddali platformę w ręce odwiedzających. Każdy mógł na niej wykreować kolejny „dylemat” i poddać go pod osąd międzynarodowej społeczności internetowej. Tym samym, oprócz wybierania pomiędzy 5 a 1 osoba, pojawiły się też i inne. Można wybierać np. czy ważniejsze jest dla nas życie psów czy kotów, zwierząt czy ludzi, 5 osobowej rodziny, jadącej samochodem czy piątki dzieci na przejściu itd.

Według informacji podanych przez MIT Technology Review eksperyment przeszedł najśmielsze oczekiwania Media Labu. Przez cztery lata od uruchomienia platformy miliony ludzi z 233 krajów i różnych rejonów geograficznych świata podjęło ponad 40 milionów decyzji w 10 różnych językach. W ten sposób powstało jedno z największych badań, jakie kiedykolwiek przeprowadzono na temat globalnych preferencji moralnych.

O wyniku decyduje kultura

Opracowanie wyników eksperymentu ukazało się miesiąc temu w magazynie Nature i płynące z niego wnioski są bardzo interesujące. Okazuje się, że wybory etyczne różnią się w zależności od kultury, w jakiej zostaliśmy wychowani, sytuacji ekonomicznej i położenia geograficznego.

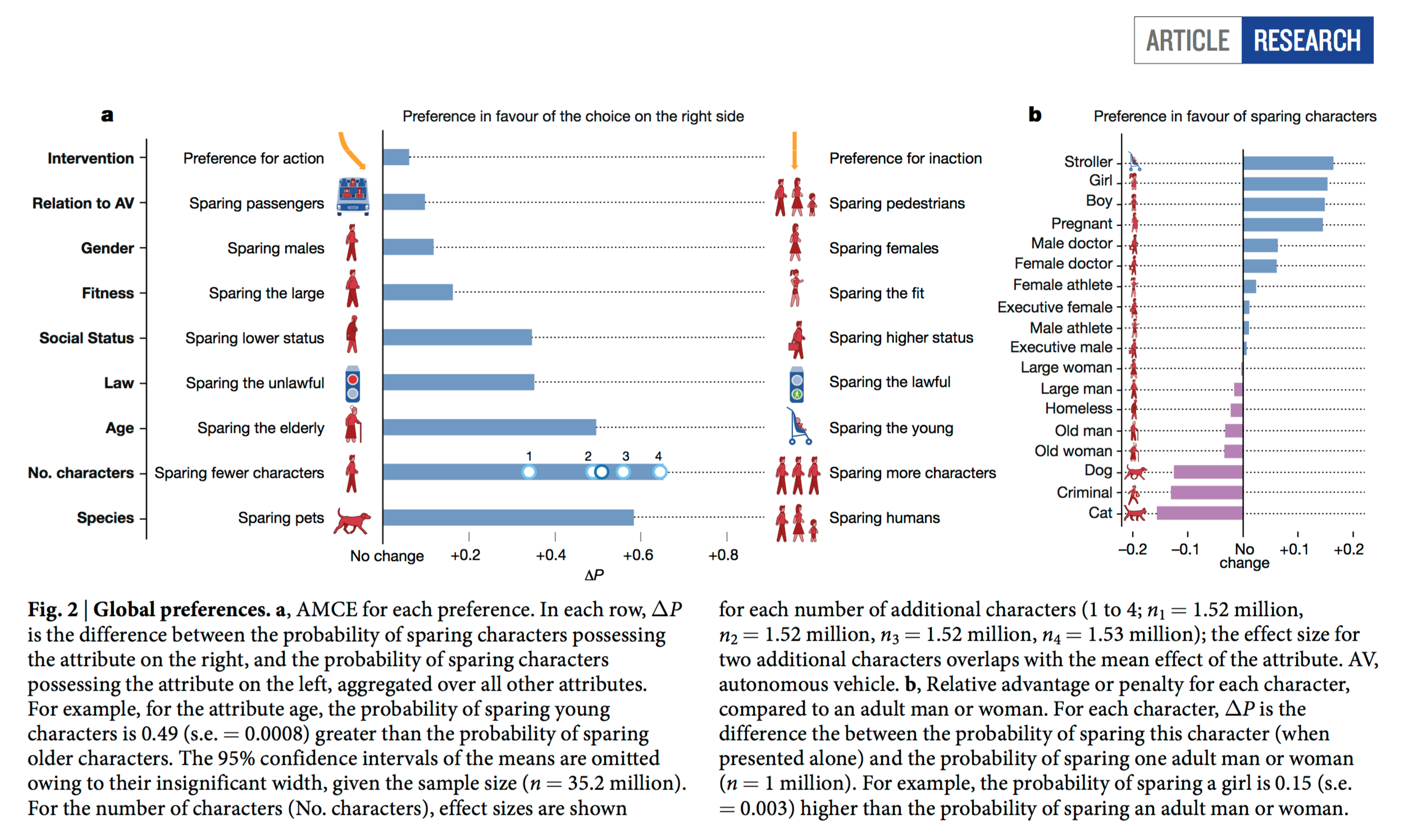

Globalnie, uśrednione wyniki pokazują między innymi, że zdecydowanie bardziej wolelibyśmy uratować 4 istnienia ludzkie niż jedno, rodzinę niż psa, dziecko niż osobę starszą. Już nie tak wyraźnie, ale wciąż zauważalnie bardziej cenimy życie osoby wysportowanej niż otyłej, pieszych niż pasażerów, kobiety niż mężczyzn i… najchętniej nie podejmowalibyśmy, żadnych trudnych decyzji.

Globalne preferencje. Po lewej 9 cech, w których można było dokonywać wyborów. Po prawej wykres pokazuje na kim nam bardziej zależy (lub nie) w stosunku do punktu odniesienie jakim jest dorosła kobieta lub mężczyzna. (ilustracja pochodzi z publikacji w Nature)

Na poziomie poszczególnych państw sytuacja jest już odmienna. Przykładowo w krajach, w których dominuje kultura kolektywistyczna (wspólnotowa), takich jak Chiny, Tajwan, Korea Płd., Japonia, dominuje tendencja do ocalenia ludzi starszych.

Odwrotnie jest w krajach o silnym indywidualizmie (Francji, Grecji, Kanadzie, Wielkiej Brytanii). Równocześnie mieszkańcy Francji, Izraela, Wielkiej Brytanii, USA, Kanady, Norwegii przywiązują większą wagę do ocalania jak największej liczby istnień ludzkich.

Kulturowe uwarunkowanie nie ma jednak już takiego wpływu na podejmowanie decyzji na temat tego czy w wypadku powinni ocaleć pasażerowi autonomicznego samochodu czy piesi. Izraelczycy, Amerykanie, Francuzi, Tajwańczycy, Estończycy, a przede wszystkim Chińczycy ratowaliby pasażerów, zaś pieszych ocaliliby najbardziej Japończycy, mieszkańcy Skandynawii, Singapurczycy, Anglicy, Niemcy, Szwajcarzy, Holendrzy.

Różnic jest więcej. W krajach o dużych różnicach ekonomicznych do głosu dochodzi status społeczny, który ma wpływ na ratowanie życie pojedynczego pieszego Tak samo w zależności od pojmowania praworządności zmienia się traktowanie pieszych, którzy przechodzą na czerwonym albo zielonym świetle.

Co wybierzecie? (rys. Moral Machine)

Badanie biorące pod uwagę 9 różnych cech doprowadziło do zdefiniowania trzech silnych preferencji, które mogą posłużyć za podstawę do dyskusji na temat powszechnej etyki maszyn. Bez względu na nacje, średnie wyniki pokazały, że ludzkości zależy przede wszystkim na trzech rzeczach: ocaleniu życia ludzkiego, ocaleniu jak największej ilości osób i ocaleniu dzieci.

Różne zasady, dla różnych kultur?

Bynajmniej! Choć naukowcy mają świadomość, że ich badanie może być wypaczone. Uczestniczyli w nim tylko internauci, czyli osoby o pewnym statusie społecznym i wiedzy technicznej. Jednak przy tak dużej ilość osób, które w nim wzięły udział powinno się je traktować bardzo poważnie. Tym bardziej, że w pierwszej kolejności autonomiczne auta trafią do lepiej sytuowanych ekonomicznie osób, mieszkających w bogatszych krajach.

Badacze są jednak bardzo ostrożni. Uważają, że nawet tak duża próba nie upoważnia ich do stwierdzenia, że zbadali wszelkie możliwe dylematy, jakie stoją przed konstruktorami autonomicznych maszyn. Do takich wniosków jest jeszcze bardzo daleko. Podczas eksperymentu nie brano chociażby pod uwagę scenariusza, w którym trzeba by decydować o życiu pieszego, będącego bardzo bliską nam osobą.

Dlatego zanim nasze samochody zaczną podejmować decyzje, badacze wskazują na potrzebę globalnej dyskusji nad tym, jak mają działać ich algorytmy moralne. Producenci i instytucje rządowe muszą podjąć decyzje niekoniecznie kierując się tym co myślimy.

Tymczasem sami poddajcie się badaniu, wchodząc na witrynę Moral Machine.

You must be logged in to post a comment.